iOS 16 a apporté un nouveau menu permettant de profiter de l'audio spatial personnalisé. Celui-ci utilise la caméra TrueDepth afin de faire un scan de l'oreille de l'utilisateur, promettant ainsi d'améliorer la qualité du son. Cette technique était jusqu'à présent assez contraignante, et Apple l'a grandement simplifiée dans les dernières bêtas d'iOS 17.

Auparavant, le menu demandait de faire un scan de chaque oreille de manière indépendante : il fallait donc mettre le téléphone au niveau de son oreille droite, hocher la tête plusieurs fois, puis recommencer avec l'oreille gauche. L'expérience n'était pas forcément fluide, le scan ayant tendance à être long. Il fallait parfois s'y reprendre en plusieurs fois.

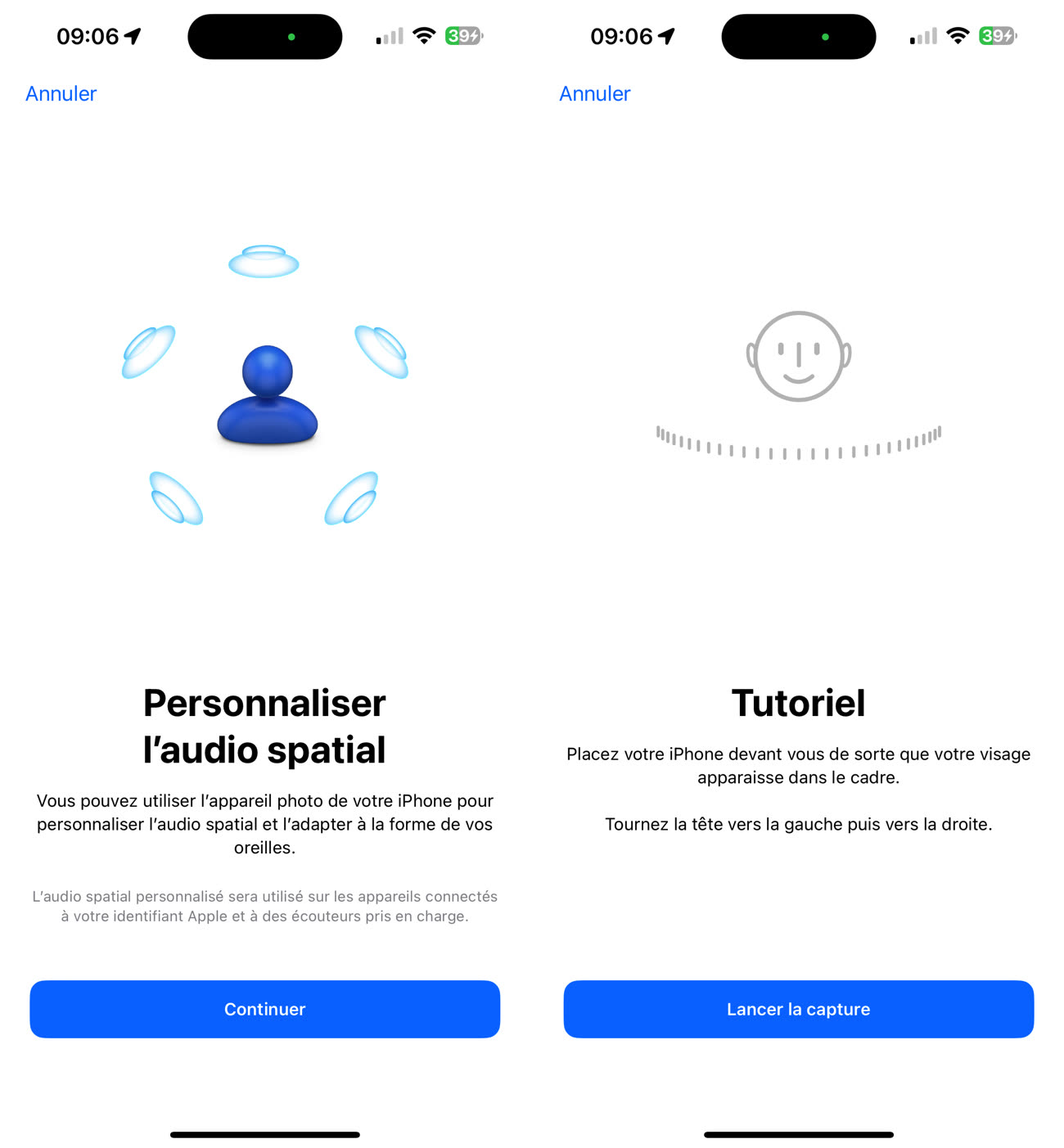

La manipulation est désormais beaucoup plus simple étant donné qu'il suffit de faire un seul et unique scan, à la manière de Face ID. Sur la troisième bêta d'iOS 17.2, il faut simplement maintenir le téléphone face à son visage avant de tourner la tête à droite, puis à gauche (avec les oreilles dégagées évidemment). Cela a pour avantage d'être nettement plus rapide.

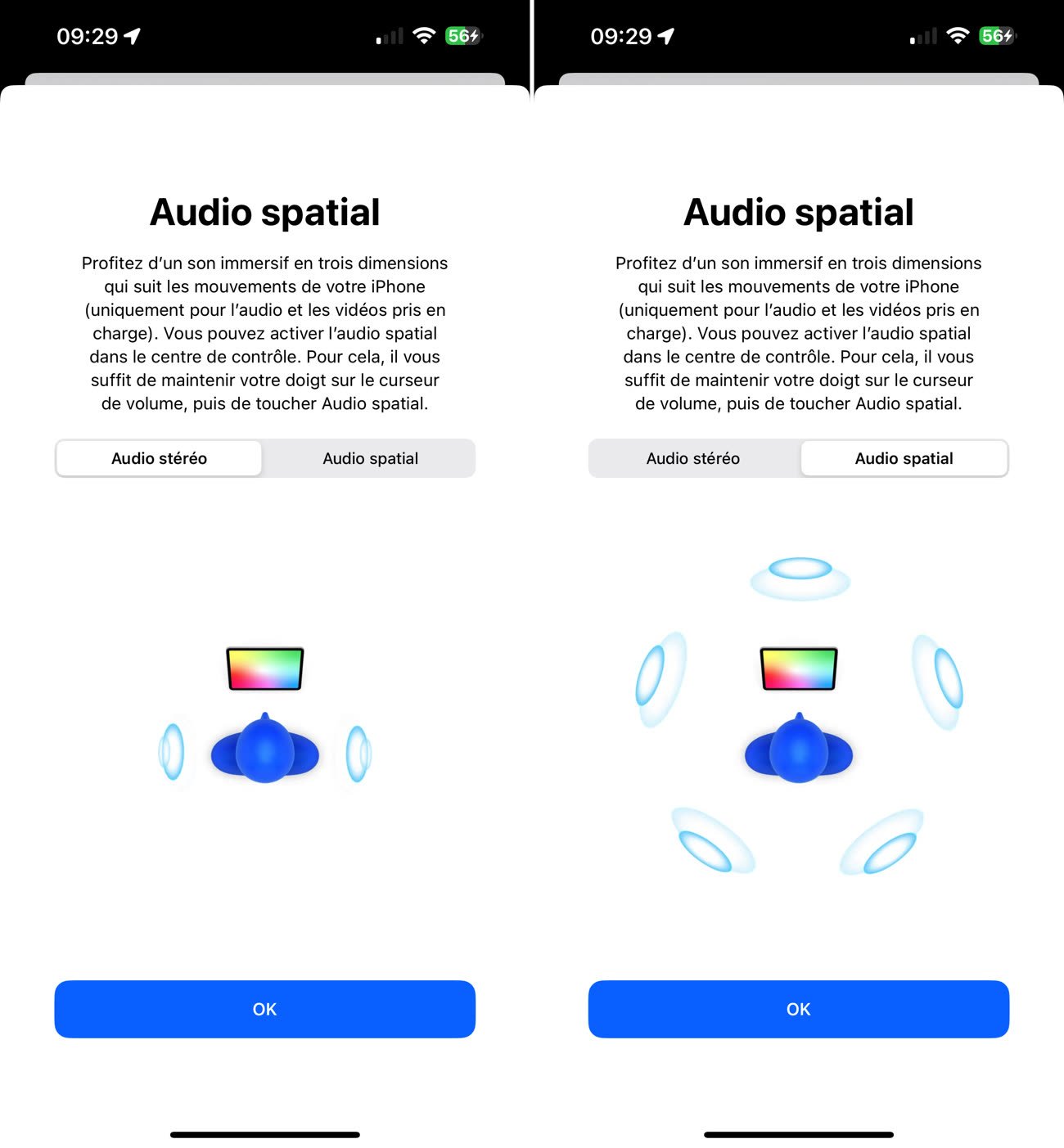

Tout cela se configure dans les Réglages, en allant chercher le menu dédié à vos écouteurs puis dans la rubrique « Audio Spatial ». Une petite démo est présente dans le menu montrant la différence avec l'audio stéréo. Notons que s'il y a du mieux, il n'est toujours pas possible d'effectuer un scan à l'aide de la caméra TrueDepth d'un iPad Pro : un iPhone, sinon rien.

Pour rappel, l'audio spatial personnalisé nécessite des écouteurs compatibles, à savoir des AirPods Pro, des AirPods Max, des AirPods de 3e génération, des Beats Fit Pro ou des Beats Studio Pro. Activer cette fonction permet de profiter d'un meilleur rendu étant donné que celui-ci sera mieux adapté à vos oreilles. La nouveauté ne fonctionne qu'avec du contenu disponible en audio spatial.